Resumen

- Sea siempre escéptico: Apple Intelligence parece más confiable que Microsoft Recall, pero confiar plenamente en cualquier empresa es un error.

- La transparencia de Apple al permitir que los investigadores de seguridad revisen el software de computación en la nube privada es un gran paso adelante.

- El esfuerzo y la transparencia son cruciales: el enfoque seguro de Apple con PCC contrasta con las prácticas negligentes de Microsoft con Recall.

Hay más debate que nunca sobre qué es unacaracterísticay qué es unapesadilla de seguridad, y la línea se está volviendo cada vez más difusa. Apple anunció Apple Intelligence, un conjunto de características de IA que se basa en computación en la nube y subcontratación opcional a OpenAI para la integraciónde ChatGPT. Microsoft presentó una vista previa de Recall, una especie de "memoria" para su computadora, pero eso se retrasó indefinidamente después de que los investigadores de seguridad descubrieron que estaba almacenando los datos en registros de texto sin formato. También hay rumores de que Google está desarrollando una característica similar a Recall. Entonces, ¿en cuál de estas características de software intrusivas debería confiar, si es que hay alguna?

Deberías ser escéptico con todo, pero si tuviéramos que clasificar estos servicios, confiaría mucho más en Apple Intelligence que en Microsoft Recall. Mi colega Adam Conway explicó recientemente por qué cree quees más fácil confiar en Recall que en Apple Intelligence, y tiene que ver con la forma en que todo lo que Recall almacena se guarda en el dispositivo. Es un argumento completamente válido, pero en mi opinión, el procesamiento en el dispositivo no es inherentemente más seguro que la computación en la nube. Microsoft decidió descuidar la seguridad y la privacidad al almacenar la información en texto sin formato, mientras que Apple desarrolló un sistema operativo de computación en la nube privada completamente nuevo para garantizar que sus datos estén seguros, donde sea que se almacenen.

Siempre prefiero a la empresa que hace el mayor esfuerzo posible para mantener mis datos seguros antes que a otra que no lo hace. El desastre que fue el anuncio y el desenlace de Recall demuestra que los beneficios técnicos del procesamiento en el dispositivo no pueden superar los inconvenientes de la incompetencia humana (o corporativa). En honor a Apple, creo que lo está intentando. Después de ver que la empresa tenía la intención de almacenar datos personales y privados en registros de texto sin formato, no puedo decir lo mismo de Microsoft.

3Está abierto y revisable.

Apple no oculta nada: te pagará si descifras Private Cloud Compute

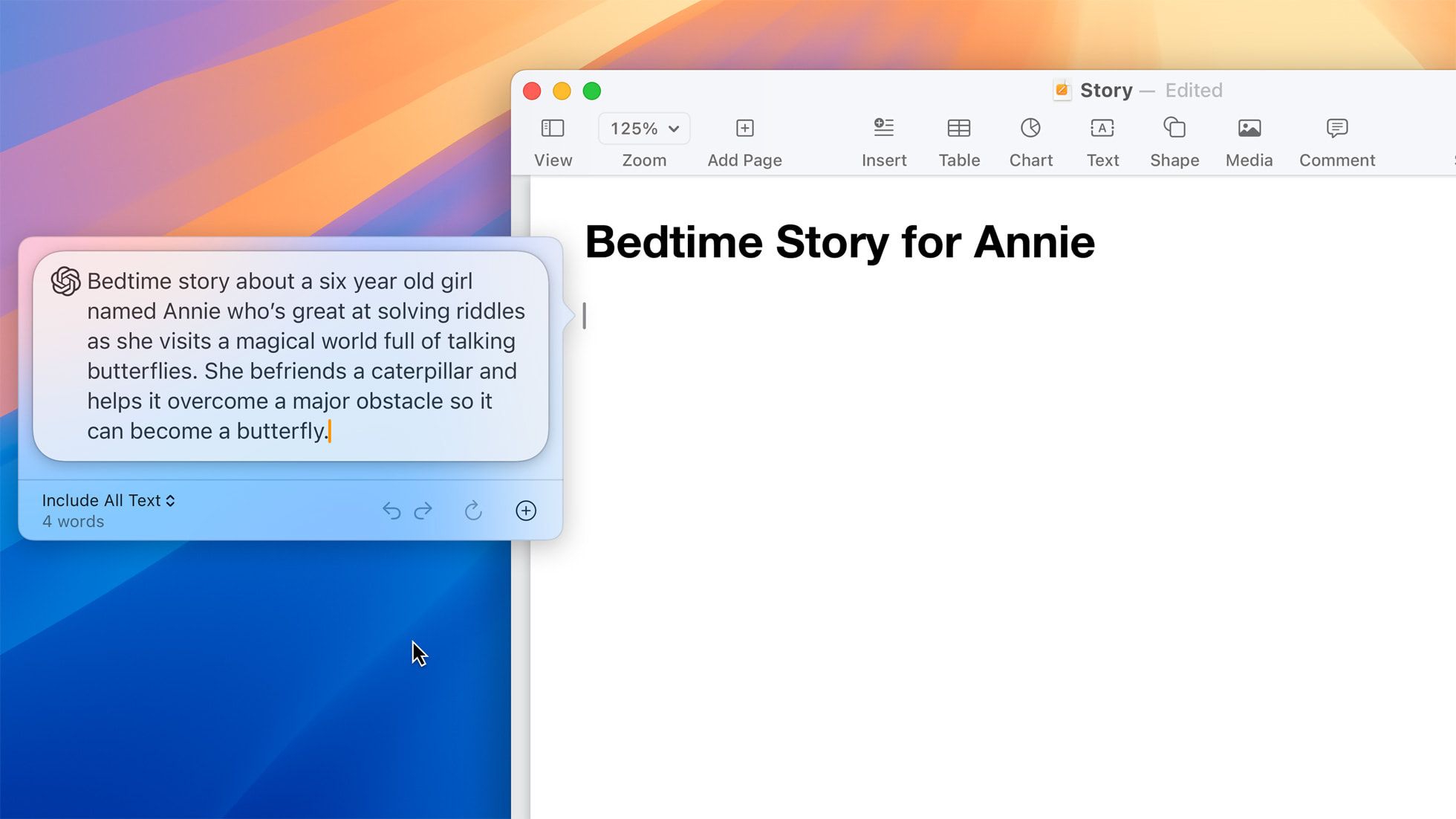

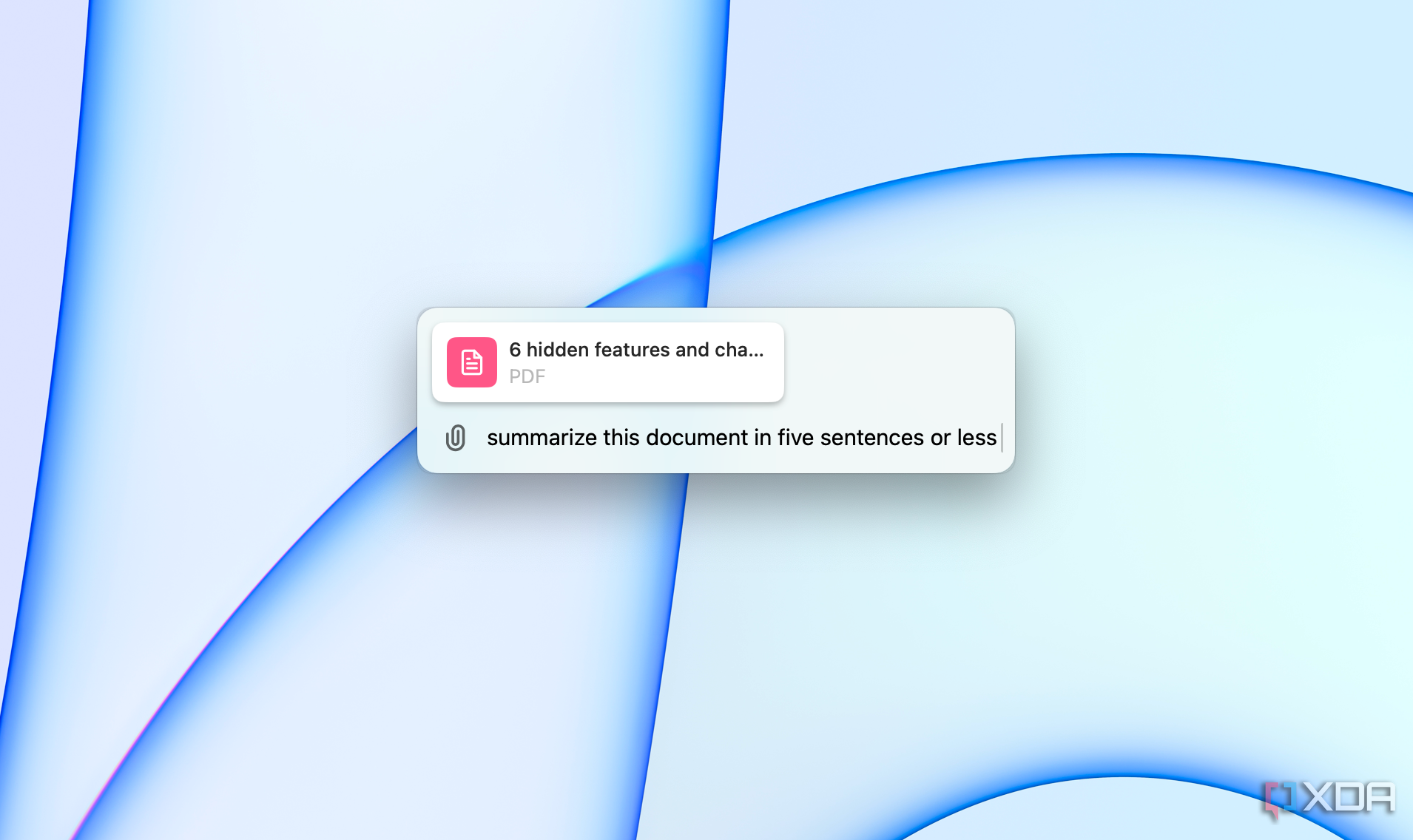

Históricamente, Apple mantiene su software propietario en secreto y en privado, pero sabe que Apple Intelligence no será aceptada con una confianza ciega. Por eso hizo una promesa bastante importante: hacer que Private Cloud Compute (el modo de Apple Intelligence que se ejecuta fuera del dispositivo y en un sistema operativo personalizado y seguro en servidores de silicio de Apple) sea verificable y transparente. Como explica la empresa en unapublicación de su blog de seguridad, Apple pondrá a disposición de los investigadores de seguridad todas las compilaciones de producción de PCC:

Cuando lancemos Private Cloud Compute, daremos el extraordinario paso de ponera disposición del público imágenes de software de cada versión de producción de PCC para la investigación de seguridad. Esta promesa también es una garantía exigible: los dispositivos de los usuarios estarán dispuestos a enviar datos solo a los nodos de PCC que puedan certificar criptográficamente que ejecutan software listado públicamente. Queremos asegurarnos de que los investigadores de seguridad y privacidad puedan inspeccionar el software de Private Cloud Compute, verificar su funcionalidad y ayudar a identificar problemas, tal como pueden hacerlo con los dispositivos de Apple.

Esto no es algo que hagan muchas empresas, especialmente en el caso del software del lado del servidor con el que los usuarios no interactúan directamente. Es propiedad de Apple e incluso incluye un híbrido personalizado de las bases iOS y macOS. La decisión de poner el software de PCC a disposición para su revisión demuestra dos cosas. Muestra que Apple confía lo suficiente en sus prácticas de seguridad como para describir sus objetivos de privacidad y dejar que los investigadores verifiquen que está cumpliendo con estos objetivos autoimpuestos. También es una prueba de que a Apple le importa lo suficiente la seguridad como para permitir que su software propietario, que normalmente se mantiene internamente, salga al mercado para su revisión.

Por si sirve de algo, Apple está poniendo en práctica sus palabras. "El programa Apple Security Bounty recompensará los resultados de las investigaciones en todo el conjunto de software Private Cloud Compute, con pagos especialmente significativos por cualquier problema que socave nuestras afirmaciones sobre privacidad", escribe la empresa en el blog de seguridad. En otras palabras, Apple está diciendo esto: si nos demuestras que estamos equivocados, te pagaremos bien. Las recompensas de seguridad no son nuevas, pero este tipo de compromiso es otro indicador de que Apple cree que Private Cloud Compute es el sistema de nube más seguro que hemos visto nunca.

Puede que no crea en la palabra de Apple sobre la seguridad de Apple Intelligence y PCC, pero sí en la de los investigadores de seguridad independientes y de probada eficacia que seguramente harán todo lo posible por desmantelar PCC antes de que se estrene. Esos mismos investigadores son los que expusieron los fallos de la retirada de productos de Microsoft. Es posible que encuentren problemas con Apple Intelligence y PCC, pero hasta que eso ocurra, confiaré más en Apple Intelligence.

2Es transparente y lleno de opciones.

¿No quieres utilizar la integración de ChatGPT? No tienes por qué hacerlo.

Apple no oculta nada en materia de seguridad y el usuario decidirá si quiere confiar en Apple Intelligence o enviar sus solicitudes a OpenAI para obtener la respuesta de ChatGPT. Lamentablemente, los usuarios no sabrán si su solicitud de Apple Intelligence se está gestionando en el dispositivo o por PCC, pero se les preguntará explícitamente si quieren utilizar ChatGPT. Apple también indica claramente qué tipo de procesos utilizan determinadas prácticas de seguridad, como el cifrado de extremo a extremo. Puedes leer sobre cómo se protegen los datos, cómo se transfieren y más, y luego tomar la decisión sobre si usarlos o no.

4 funciones de Apple Intelligence que ya puedes usar con la aplicación ChatGPT para Mac

No esperes a Apple Intelligence cuando ChatGPT para Mac ya esté aquí

No hay forma de desactivar por completo Apple Intelligence (al menos que sepamos por ahora), aunque sí se puede desactivar la integración de ChatGPT. Por supuesto, los usuarios siempre pueden simplemente no usar las funciones compatibles con Apple Intelligence si no se sienten cómodos con ellas. En cierto modo, Recall se configuró para brindarte más control que Apple Intelligence. Podrás desactivar por completo Apple Intelligence, bloquear ciertos sitios web y aplicaciones y deshabilitar Recall cuando sea necesario.

Sin embargo, la transparencia se vio afectada cuando se reveló que Recall almacenaba datos en texto sin formato. Eso significa que cualquier aplicación o usuario con acceso al almacenamiento de su computadora podría ver datos privados, y estas posibilidades no se mencionaron en absoluto cuando se anunció Recall por primera vez. Microsoft dijo que sus datos se almacenarían en el dispositivo. Lo que olvidó mencionar es quetodo loque esté en su dispositivo podría tener acceso a los datos de Recall. Esta omisión sugiere una falta de transparencia por parte de Microsoft, ya que obviamente sabía, o al menos,debería haber sabido, los riesgos con sus métodos de almacenamiento de datos.

1Apple realmente lo está intentando

El esfuerzo y la intención importan, y tenemos que dejar de fingir que no lo son.

Nuevamente, es posible que los investigadores de seguridad encuentren formas de frustrar la computación en la nube privada. Es imposible ignorar el esfuerzo que Apple puso en proteger la computación en la nube privada incluso si eso sucede. El enfoque de Microsoft para mantener los datos de Recall en el dispositivo fue vago e inseguro. La seguridad de los datos implica más que simplemente considerar si se mantienen en el dispositivo o fuera de él. El primero es más seguro en teoría, pero el segundo a veces puede ser más seguro en la práctica, y explicaré por qué.

Imagínate que dejaste tu tarjeta de seguridad social (un documento muy importante y privado para los ciudadanos estadounidenses) sobre la mesa de tu casa, cerrada con llave. La tarjeta nunca sale de tu casa y está protegida por un candado, pero aun así no es muy segura. Es posible que dejes entrar a tu casa a personas que no quieres que vean tu número de seguridad social. También es posible que no quieras que a un posible ladrón le resulte tan fácil robar tu identidad dejándola sobre la mesa.

Copilot+ ya está aquí: aclaremos todo sobre esa controvertida función Recall

Ahora puedes salir y adquirir un dispositivo que pueda ejecutar Copilot+, así que exploremos cómo Microsoft ha manejado el problema del retiro antes de que compres uno.

Ahora, pensemos nuevamente en este escenario en el contexto de Recall. Este sistema almacena sus datos en el dispositivo y rastrea cada uno de sus movimientos de manera predeterminada. Estos datos están bloqueados con una contraseña de computadora, pero se almacenan en texto sin formato para que los pueda ver cualquier persona que tenga acceso a su computadora. ¿Le gustaría que alguien a quien le preste su computadora portátil por un segundo pueda rastrear cada uno de sus movimientos con los datos de Recall? ¿Le gustaría que alguien que pirateara su computadora pudiera encontrar fácilmente un registro de su actividad, revelando información potencialmente confidencial? Supongo que la respuesta sería no.

El objetivo de esta analogía es demostrar que los esfuerzos de seguridad no se detienen cuando se guardan los datos en el dispositivo: todavía hay trabajo por hacer, y Microsoft no lo hizo. El concepto de almacenar este tipo de información en registros de texto sin formato es tan inaudito que el investigador que lo descubriódijo que "retrasó deliberadamente la privacidad una década".No es que Microsoft haya cometido un error, es como si la empresa ni siquiera lo hubiera intentado.

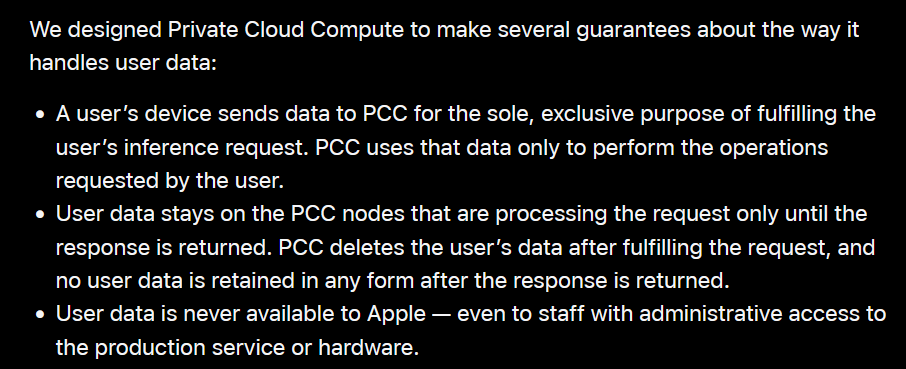

Mientras tanto, aquí hay solo algunos detalles sobre el trabajo que realizó Apple para hacer que Private Cloud Compute con Apple Intelligence sea lo más seguro posible:

No soy desarrollador ni ingeniero, pero sé que es bastante difícil crear algo como PCC sin herramientas de gestión de servidores o shells remotos integrados. Apple hizo un gran esfuerzo para que esta cosa fuera segura, y el esfuerzo que Apple hace aquí es digno de mi confianza. Creo de todo corazón que si Apple Intelligence y Recall se lanzaran hoy, Apple Intelligence sería más seguro. Es mucho más fácil vulnerar una computadora portátil con Windows que vulnerar un servidor PCC.

Sería increíblemente prematuro decir que Apple Intelligence y PCC son impenetrables. No voy a hacer esa afirmación en lo más mínimo. Sin embargo, creo que el esfuerzo de Apple por crear entornos seguros al comienzo de PCC presagia el esfuerzo que pondría en fortalecerlo en caso de que tuviera una falla de seguridad. En comparación, Microsoft no se molestó en encontrar una manera de almacenar los datos de Recall en algo que no fuera texto simple. Esto me hace pensar que a Microsoft nunca le importó realmente hacer que Recall fuera lo más seguro posible, por lo que no confío en él.

Mi consejo es que siempre seáis escépticos.

Yo era escéptico con respecto a la retirada de productos de Microsoft cuando se anunció por primera vez, y mucho antes de que los investigadores diseccionaran sus deficientes prácticas de seguridad. Tengo el mismo escepticismo hacia Apple Intelligence, pero creo en lo que puedo ver, y Apple está publicando todo lo que hay que saber sobre Private Cloud Compute antes de su lanzamiento. Los expertos en seguridad pueden revisar cada parte de Private Cloud Compute, hasta el cargador de arranque en texto sin formato. Si un hacker de sombrero blanco encuentra un fallo en PCC, Apple le pagará. Los investigadores tienen las herramientas y el incentivo para destrozar el PCC de Apple: si hay una vulnerabilidad, la descubriremos.

En definitiva, no hay que creerse del todo las promesas de ninguna empresa ni tomarse al pie de la letra sus declaraciones. Confiar ciegamente en Apple o Microsoft porque nos gustan sus productos, respetamos su trayectoria o creemos en sus afirmaciones de marketing sería un gran error. Todas las empresas tienen una excelente trayectoria en materia de privacidad y seguridad de los usuarios hasta que dejan de tenerla. Si esperamos a que una empresa sufra su primer incidente de seguridad y privacidad (como Meta y su escándalo de Cambridge Analytica), será demasiado tarde. Seasiempreescéptico.