Tras la presentación principal de ayer enGoogle I/O 2021, la compañía celebró varias sesiones que ahora están disponibles bajo demanda a través de YouTube. Una de las sesiones abordó las novedades en aprendizaje automático para Android y cómo Google lo está haciendo más rápido y consistente para los desarrolladores.

El aprendizaje automático es responsable de potenciar las funciones que los propietarios de Android utilizan todos los días, desde el desenfoque de fondo en las imágenes, el reemplazo de fondo en las aplicaciones de videollamadas ylos subtítulos en vivo en las llamadasen los teléfonos Pixel. Si bien el aprendizaje automático se está volviendo cada vez más avanzado, Google dijo que aún existen varios desafíos en la implementación de funciones impulsadas por ML, incluidas las preocupaciones sobre la sobrecarga de aplicaciones y la variación del rendimiento. También hay problemas con la disponibilidad de funciones porque no todos los dispositivos tienen acceso a las mismas API o versiones de API.

Imagen: Google

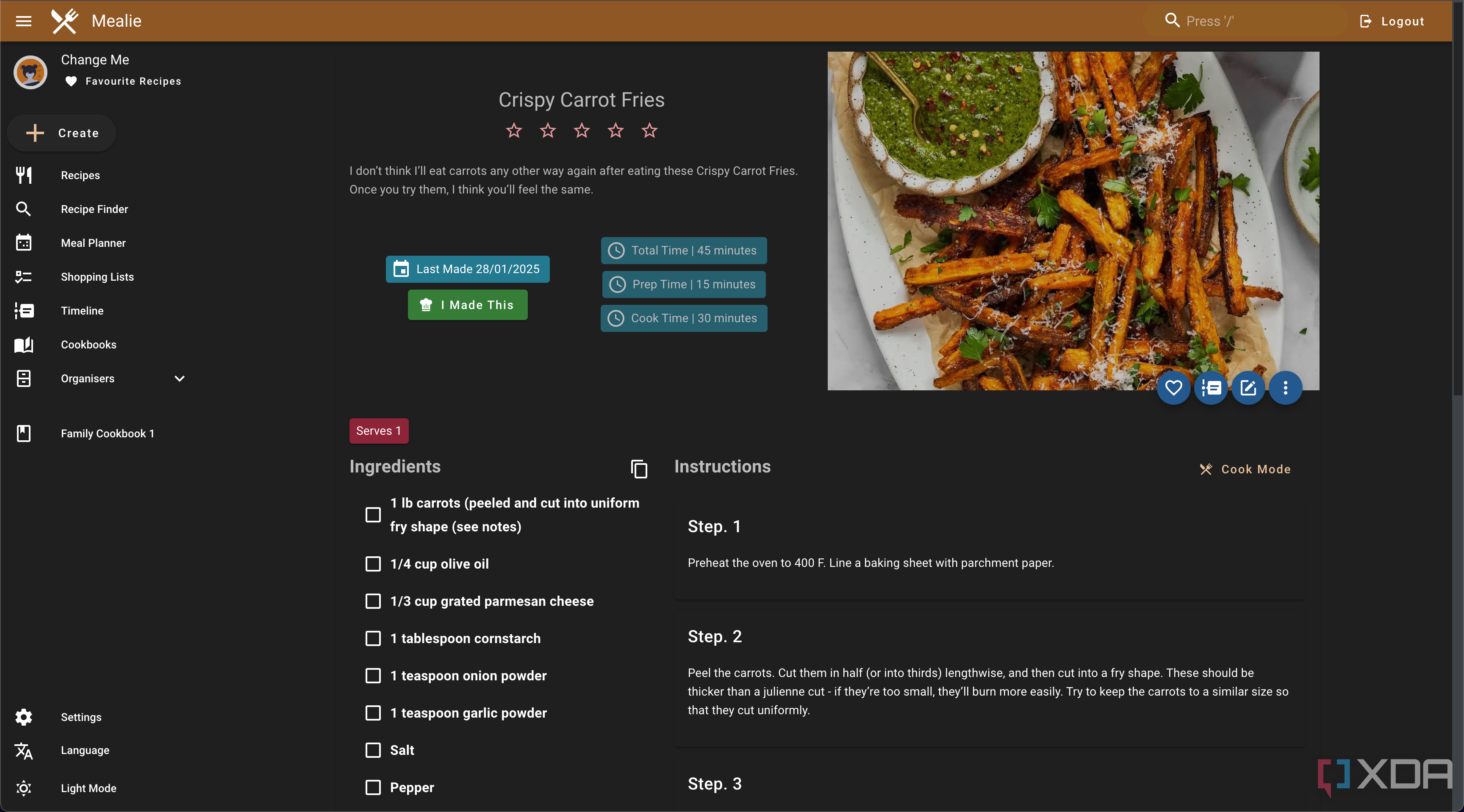

Para solucionar este problema, Google anuncia la pila de inferencia de aprendizaje automático totalmente integrada y actualizable de Android, de modo que habrá un conjunto de componentes comunes en todos los dispositivos que funcionarán en conjunto. Esto ofrece los siguientes beneficios a los desarrolladores de aplicaciones:

- Los desarrolladores ya no necesitan agrupar código para la inferencia en el dispositivo en su propia aplicación.

- Las API de aprendizaje automático están más integradas con Android para ofrecer un mejor rendimiento cuando esté disponible.

- Google puede proporcionar una API consistente en todas las versiones y actualizaciones de Android. Las actualizaciones periódicas de las API provienen directamente de Google y existen independientemente de las actualizaciones del sistema operativo.

Imagen: Google

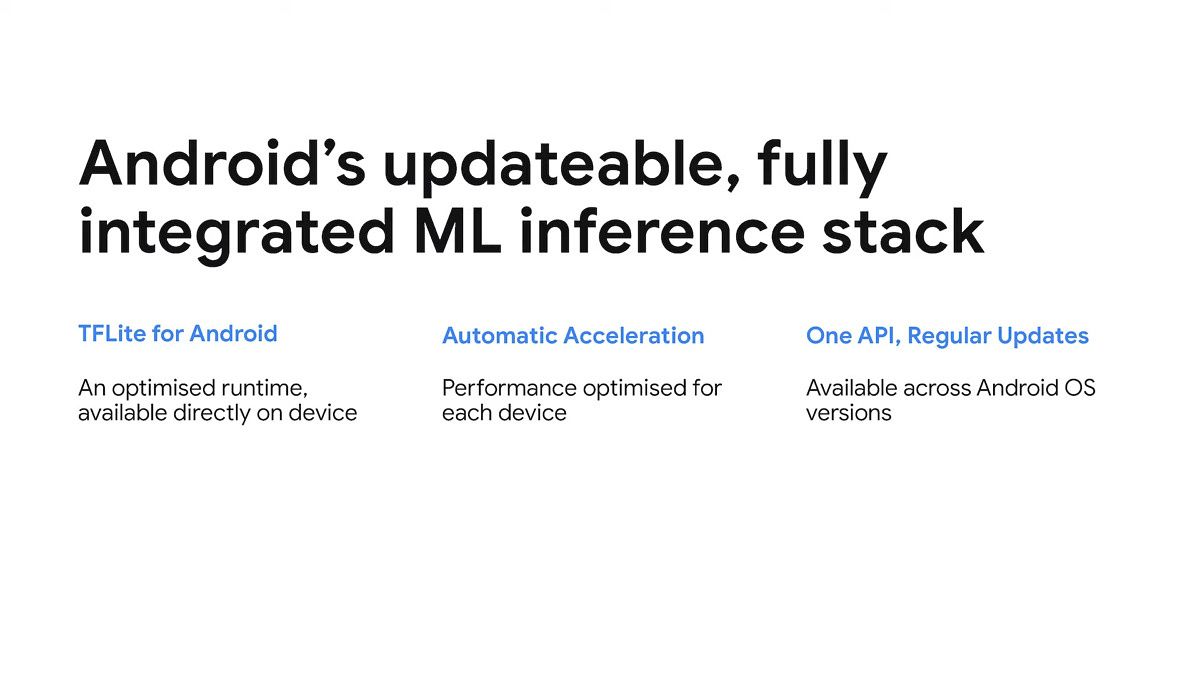

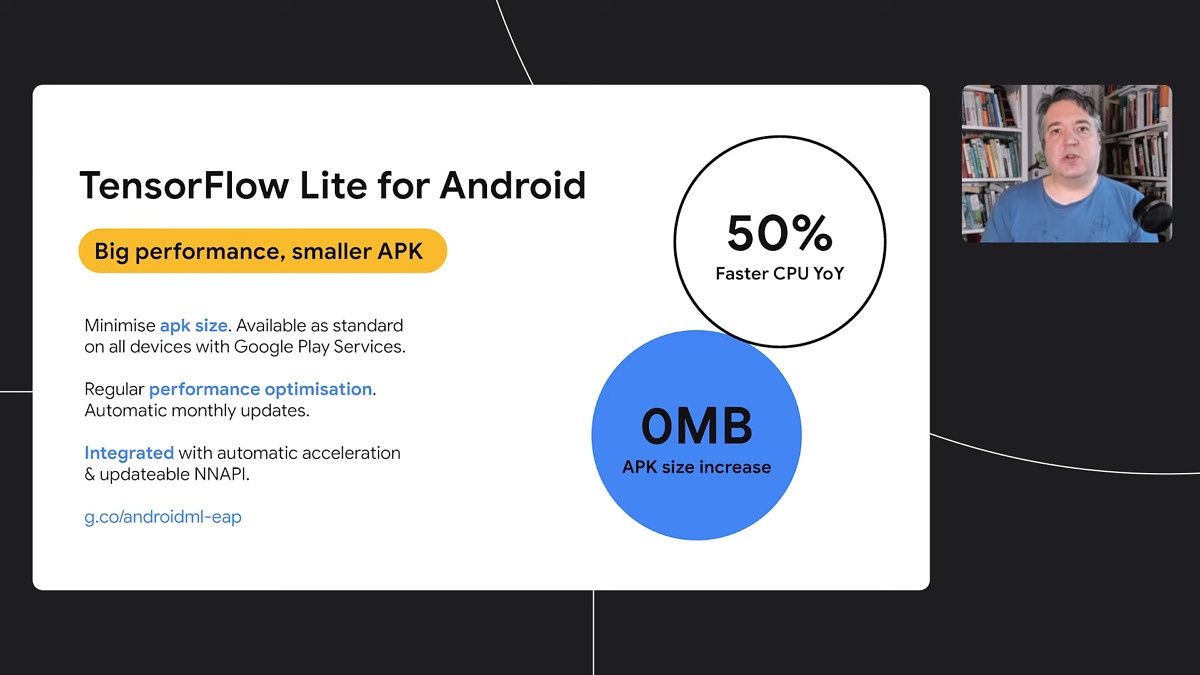

Para que esto suceda, Google está haciendo algunas cosas. Primero, dijo queTensorFlow Lite para Androidse preinstalará en todos los dispositivos Android a través de Google Play Services, por lo que los desarrolladores ya no necesitarán incluirlo en sus propias aplicaciones. Google también está agregando una lista de GPU compatibles en Android que se pueden usar para la aceleración de hardware. El gigante de las búsquedas también está presentando la "aceleración automática" que tiene en cuenta el modelo de aprendizaje automático de un desarrollador y puede verificar si el modelo funciona mejor acelerado en la CPU, la GPU u otros aceleradores.

Imagen: Google

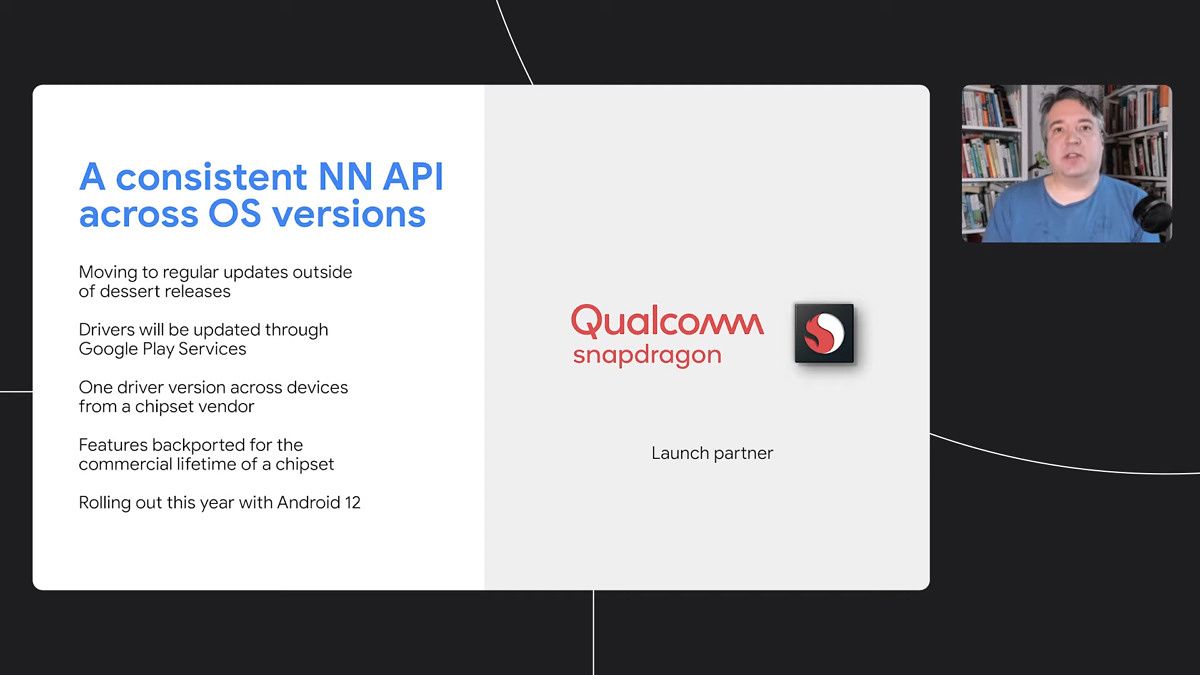

A continuación, Google también dijo que está alejando NNAPI del marco central del sistema operativo para que sea actualizable a través de Google Play Services. Eso significa que los desarrolladores pueden usar la misma especificación NNAPI incluso si dos dispositivos ejecutan diferentes versiones de Android. Cabe destacar que elentorno de ejecución NNAPIse agregó como unmódulo de línea principalen Android 11, que es posiblemente la forma en que se entregan estas actualizaciones. Google está trabajando con Qualcomm para que los controladores NNAPI actualizables estén disponibles en dispositivos que ejecutan Android 12, y las nuevas funciones se incorporarán a la vida útil comercial de un chipset. Además, las actualizacionesse entregarán periódicamentey también serán compatibles con los procesadores Snapdragon más antiguos.

Las mejoras en el aprendizaje automático son solo una pequeña fracción de lo que Google anunció esta semana. El gigante de las búsquedas dio a conocer un importante rediseño enAndroid 12 y también compartió los primeros detalles sobre su colaboración con Samsung pararenovar Wear OS.

\r\nhttps://www.youtube.com/watch?v=uTCQ8rAdPGE\r\n